O iOS 26 trouxe diversos recursos novos ao iPhone, mas muitos deles soam familiares para quem acompanha o universo Android.

A Apple, que tradicionalmente adota uma abordagem mais cautelosa antes de lançar certas funções, resolveu liberar de uma vez só uma série de ferramentas já conhecidas dos usuários do Android – especialmente das linhas Pixel e Galaxy.

Apesar do grande destaque ser o novo visual “Liquid Glass”, com efeitos translúcidos e animações dinâmicas, o que chamou a atenção foi a quantidade de funções que poderiam facilmente ter sido tiradas diretamente dos aparelhos concorrentes.

A seguir, mostramos quais são esses recursos e há quanto tempo eles já existem no mundo Android.

Chamadas filtradas automaticamente (Call Screening)

A Apple finalmente trouxe para o iPhone o recurso que permite ao sistema atender e filtrar chamadas automaticamente, identificando possíveis ligações de spam.

No Android, isso existe desde 2018 com o Google Assistant nos celulares Pixel 3, ganhando modo automático em 2022 com o Pixel 7.

A funcionalidade, agora parte do iOS 26, promete aliviar a frustração com ligações indesejadas, algo que alguns poucos usuários do Android já desfrutam há anos.

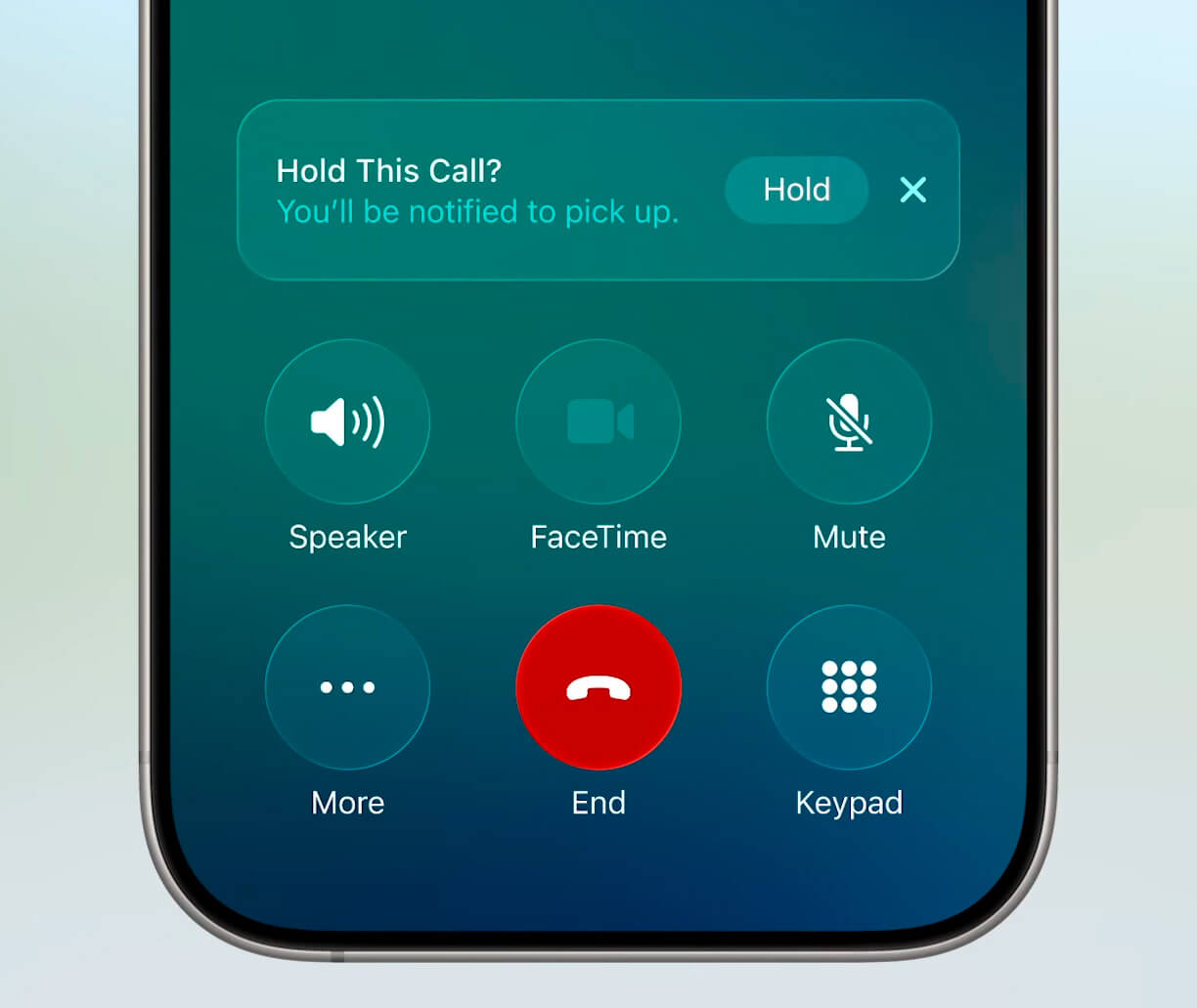

Espera inteligente com alerta humano (Hold Assist)

Outra função que chega agora ao iPhone, mas que já existe desde 2020 nos Pixels, é o assistente de espera.

Ao ligar para uma central e ser colocado em espera, o celular escuta a chamada para você e avisa quando alguém humano finalmente estiver na linha.

Nada de ficar ouvindo música de elevador por meia hora com o telefone grudado na orelha.

Tradução em tempo real no app de Telefone

A tradução ao vivo em chamadas telefônicas impressionou quem assistiu à WWDC 2025, mas o recurso já havia sido incorporado pela Samsung em 2023, nos Galaxy S23 e, depois, nos seguintes.

Ele permite traduções faladas bidirecionais, sendo útil em situações simples como reservar um hotel ou mesa no restaurante em outro idioma.

A novidade da Apple também funciona em chamadas e mensagens, usando os modelos de linguagem locais para preservar a privacidade, uma abordagem semelhante à que a Samsung e o Google já adotaram em parte.

Sugestões contextuais com base na tela (estilo Circle to Search)

A nova função do iOS 26 que permite ao usuário tirar uma captura de tela e, com base nela, criar eventos ou fazer buscas, lembra bastante o “Circle to Search”, lançado pelo Google em 2024 com os Pixel 8 e Galaxy S24.

No Android, essa ideia evoluiu de projetos anteriores como o Google Now on Tap (2015) e o Google Lens (2017).

A diferença aqui é que a Apple baseia tudo em screenshots, enquanto o Android permite interações diretas com o conteúdo da tela ativa.

Mas o princípio é o mesmo: entender o contexto e oferecer ações úteis a partir do que o usuário está vendo.

Interface da câmera com foco em foto e vídeo

No iOS 26, a interface da câmera foi simplificada: apenas os modos “Foto” e “Vídeo” aparecem por padrão, com os demais acessíveis por gestos laterais.

Isso remete diretamente à interface da câmera dos aparelhos Pixel, que desde 2021 já destacam um botão fixo para alternar entre esses dois modos principais.

É uma mudança bem-vinda, que aproxima a experiência do iPhone da usabilidade que o Android já vinha oferecendo.

Quer dizer que basta comprar um Android qualquer para eu ter isso?

Não é bem assim.

Apesar do conceito popular de que o Android é acessível e que disponibiliza tudo o que a Apple oferece, por um preço bem menor, a realidade é outra.

Google e Samsung costumam restringir suas funcionalidades mais avançadas aos seus próprios dispositivos e aplicativos nativos, como o app Telefone do Pixel ou o sistema One UI nos Galaxy.

Essas funções não são disponibilizadas via APIs públicas para desenvolvedores terceiros, o que impede sua integração em apps populares como WhatsApp ou Telegram.

Mesmo quando funcionam em apps de terceiros, como o Live Translate da Samsung, isso acontece por meio de intervenções do sistema, e não porque os apps têm acesso direto aos recursos.

Ou seja, Google e Samsung não são tão diferentes da Apple nesse aspecto, pois também impõem limites significativos ao uso de suas inovações, mantendo-as restritas aos próprios dispositivos e apps.

Isso levanta um ponto curioso: muitos dos que promovem uma suposta “superioridade do Android” talvez nunca cheguem a usar esses recursos na prática, justamente por estarem disponíveis apenas em aparelhos topo de linha, fora do alcance da maioria dos usuários.

Quem copia quem?

É importante destacar que a troca de ideias entre Apple e Android não é de hoje.

O próprio Android 15, por exemplo, vem copiando as “atividades ao vivo” do iOS, e a Google tem investido em maior personalização nos atalhos rápidos, algo popularizado no iOS.

A diferença está no ritmo: o Android costuma lançar recursos de forma mais experimental, enquanto a Apple opta por refinamentos mais demorados, mas integrados ao sistema de forma coesa.

Quem sai ganhando? Todos nós

Apesar de alguns fãs mais fervorosos torcerem o nariz quando a Apple “se inspira” no Android, a verdade é que a concorrência entre os dois sistemas beneficia a quem realmente interessa: o usuário.

Com o iOS 26, a Apple está, sim, adotando recursos antigos do Android, mas o faz à sua maneira, com foco em privacidade, design e integração.

No fim, o que importa não é quem fez primeiro, mas quem entrega a melhor experiência. Né não?

Copiem o que é bom, e esqueça o que não funciona. Todos saem ganhando

Não tem bonzinho no meio corporativo

O ecossistema continuará integrado como só a Apple sabe fazer… Só que com mais recursos

Como não amar?